什么是Mira?Mira有什么作用?2025 Mira发展路线图是什么?

2025安币交易所下载地址(全球第一大所,通过本链接注册返佣20%)

2025Binance币安 | 一键直达

近年来,生成式人工智能的快速发展对基础设施和工作流程提出了新的要求,特别是在验证和评估方面。 Mira正在构建一个创新的第1层网络,为AI输出提供无需信任、可扩展且准确的验证。通过将复杂的AI输出分解为更小的可验证部分,并利用多个AI模型进行验证,Mira显著降低了错误率和幻觉。该平台已为多个拥有20万以上用户的AI应用提供验证服务。随着生成式AI市场预计在2030年突破1万亿美元,Mira致力于成为所有AI应用的可信任验证层,通过去中心化方式解决AI输出可靠性这一关键挑战。

长话短说

输出验证对于确保人工智能可靠运行至关重要。Mira 正在构建一个第 1 层网络,为 AI 输出提供无需信任、可扩展且准确的验证。同时减少幻觉和偏见是一种微妙的平衡行为。 Mira 通过利用人工智能模型的集体智慧来做到这一点。Mira 的验证系统建立在两个基本设计原则之上:(1) 将人工智能输出分解为更小的、易于验证的部分,以及 (2) 使用模型集合来验证每个部分。Mira 的初始市场规模与 LLMOps 相关,但其总体潜在市场可能会扩展到所有人工智能,因为每个人工智能应用程序都需要更可靠的输出。Mira 已经为多个拥有 20 万以上用户的 AI 应用程序提供 AI 验证。米拉的最终目标是成为 合成基础模型,无缝插入每个主要提供商,通过单个 API 提供预先验证的输出。幻觉: 一种对不存在的事物产生明显感知的体验

安德烈·卡帕蒂 (Andrej Karpathy) 将人工智能称为梦想机器。他认为幻觉-人工智能自信地生成不真实事物的那些时刻-是一种特征,而不是一个错误。试图完全消除它们是徒劳的。老实说,这有一些诗意。

大型语言模型(LLM)是一位艺术家,一位创造者。它用代码做梦,凭空产生想法,并从数据中解读意义。但为了让人工智能从美好的白日梦转向实际的日常应用,我们必须控制这些幻觉。

LLM 在许多任务中的错误率仍然很高,通常徘徊在 30% 左右。在这个水平上,LLM 仍然需要人工参与才能达到可用的准确性标准。

但是,当我们达到难以捉摸的 99.x% 准确率(即输出在没有人为监督的情况下可靠)时,奇迹就会发生。这是人工智能实现人类水平可靠性的门槛,解锁了以前无法实现的无穷无尽的用例。

然而,达到这种精度水平并非易事。它需要不懈的工程努力和创新。

@Mira_Network的故事从这里开始。但在我们深入探讨之前,让我们花点时间讨论一下 LLM 的发展,以及为什么验证正在成为人工智能领域的下一个重大 事件。

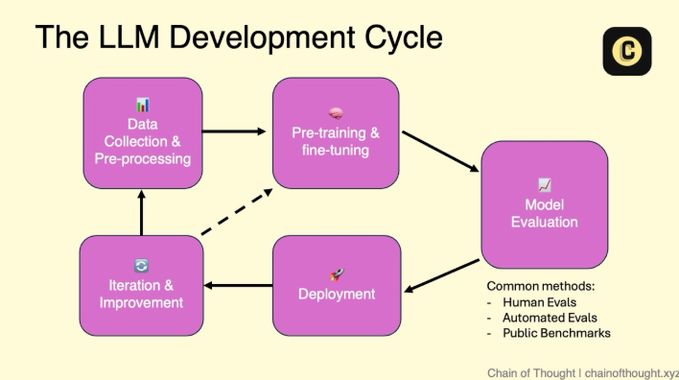

LLM 是如何诞生的

LLM 开发是深度学习之旅的最新迭代,与我们过去 50 多年磨练的传统软件开发实践不同。LLM 只存在了大约三年,完全翻转了剧本,从 确定性思维 (如果 X,则 Y) 转为概率推理 (如果 X,那么……也许是 Y?)。

这意味着人工智能驱动的世界的基础设施需要一套全新的工具和工作流程。然而,其中许多工具仍然被锁在创建 LLM 的研究实验室内。

好消息是,这些工具开始逐渐进入公共领域,为世界各地的开发人员打开了一个充满可能性的世界。

在这个新工作流程的最后,存在着一个关键的难题: 评估和验证。 今天,我们的焦点集中在这些方面。他们回答了一个基本问题: 人工智能运行良好吗?

验证=信任

信任是任何伟大人工智能产品的基础。

随着人工智能日益成为我们生活中不可或缺的一部分,该技术本身仍然脆弱。错误总会发生,当错误发生时,信任就会迅速消失。用户期望人工智能准确、公正且真正有帮助,但如果没有可靠的系统来确保这一点,他们的挫败感就会增加,而挫败感会导致客户流失。