作者:MIT(麻省理工学院)节选

编译:Felix, PANews

随着 OpenAI 的 ChatGPT 等大型语言模型(LLM)产品被广泛采用,来自全球各地的企业和人群几乎每天都在使用 LLM。与其他工具一样,LLM 也有其自身的优势和局限性。

近日,麻省理工学院(MIT)发布一项长达 206 页的研究报告,探究在撰写文章的教育情境中使用 LLM(如 ChatGPT)的认知成本,揭示了使用 LLM 对大脑及认知能力的影响。研究表明,过度依赖 OpenAI 的 ChatGPT 等人工智能聊天机器人可能会降低认知能力。

研究团队将参与者分为三组:LLM 组、搜索引擎组、仅靠大脑组,这些参与者在 4 个月的时间内,使用指定工具(仅靠大脑组则不使用工具)在限定时间内撰写文章,每次实验中,文章的主题不同。团队为每位参与者安排了 3 轮相同分组的实验。在第 4 轮实验中,团队要求 LLM 组的参与者不使用任何工具(称其为 LLM 转大脑组),而仅靠大脑组的参与者则使用 LLM(大脑转 LLM 组)。此次共招募了 54 名参与者参加前 3 轮实验,其中 18 人完成了第 4 轮实验。

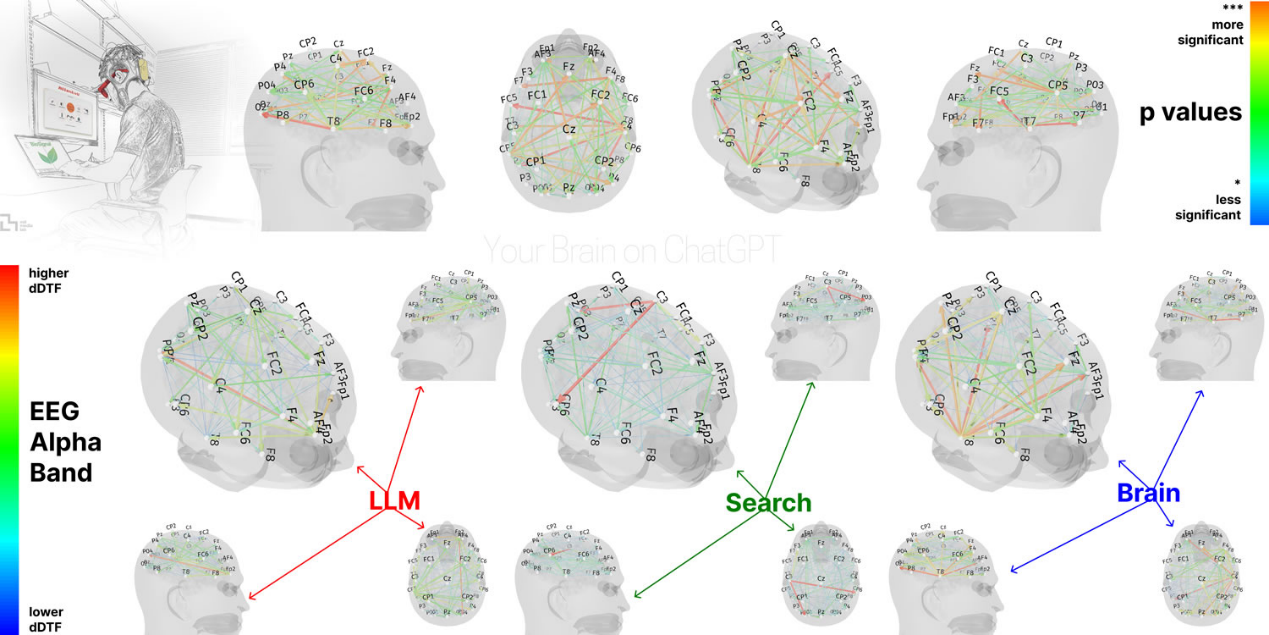

研究团队使用脑电图(EEG)记录参与者的脑电活动,以评估他们的认知投入和认知负荷,并深入了解在撰写文章任务期间的神经激活情况。团队进行了自然语言处理(NLP)分析,并在每次实验结束后对每位参与者进行了访谈。团队借助人类教师和一个 AI 评判员(专门构建的 AI 代理)的帮助进行了评分。

在自然语言处理(NLP)分析中,仅使用大脑的参与者在大多数主题的文章写作方式上表现出很大的差异性。相比之下,LLM 组在每个主题上撰写的文章在统计上趋于同质化,与其他组相比偏差明显较小。搜索引擎组可能至少在一定程度上受到搜索引擎推广和优化内容的影响。

LLM 组使用了最多的特定命名实体(NER),例如人物、姓名、地点、年份和定义;而搜索引擎组使用的 NER 数量至少少了 LLM 组的一半;仅使用大脑的组使用的 NER 数量比 LLM 组少了 60%。

参与 LLM 和搜索引擎小组的人员由于时间有限(20 分钟)而承受着额外的压力,因此更倾向于关注他们所使用工具的输出结果。他们中的大多数人都专注于重复利用工具的输出内容,从而一直忙于复制粘贴,而不是融入自己的原创想法,并从自己的视角和经历出发对这些内容进行编辑。

在神经连接模式方面,研究人员使用动态定向传递函数(dDTF)方法测量参与者的认知负荷。dDTF 能揭示网络相干性的系统性和频率特异性变化,对执行功能、语义处理和注意力调节具有重要意义。

脑电图分析表明,LLM 组、搜索引擎组和仅靠大脑组在神经连接模式上存在显著差异,这反映了不同的认知策略。大脑连接程度随着外部支持的增加而系统性降低:仅靠大脑组表现出最强、最广泛的网络,搜索引擎组表现出中等程度的参与,而 LLM 辅助组的整体耦合最弱。

在第 4 轮实验中,从 LLM 到仅靠大脑参与者表现出神经连接较弱,α 和 β 网络参与度较低;而从仅靠大脑到 LLM 的参与者表现出更高的记忆回忆能力,并重新激活了广泛的枕顶叶和前额叶节点。

在访谈中,LLM 组对其文章的归属感较低。搜索引擎组的归属感较强,但低于仅靠大脑的组。LLM 组在引用几分钟前自己所写文章的能力方面也落后,超过 83% 的 ChatGPT 用户无法引用几分钟前写的文章。

这篇尚未经过同行评审的研究表明,在为期 4 个月的研究过程中,LLM 组的参与者在神经、语言、得分层面的表现都逊于仅使用大脑的对照组。随着 LLM 在大众中的教育影响才刚刚开始显现,使用人工智能 LLM 可能实际上损害学习技能的提升,尤其是对于年轻用户而言。

研究人员表示,在 LLM 被公认为对人类有益之前,需要进行“纵向研究”来了解人工智能聊天机器人对人类大脑的长期影响。

当询问 ChatGPT 对这项研究的看法时,其回答称:“这项研究并没有说 ChatGPT 本质上有害——相反,它警告人们不要不加思考或努力地过度依赖它。”

相关阅读:a16z:从AI代理、DePIN到微支付,加密与AI融合的11个关键落地方向