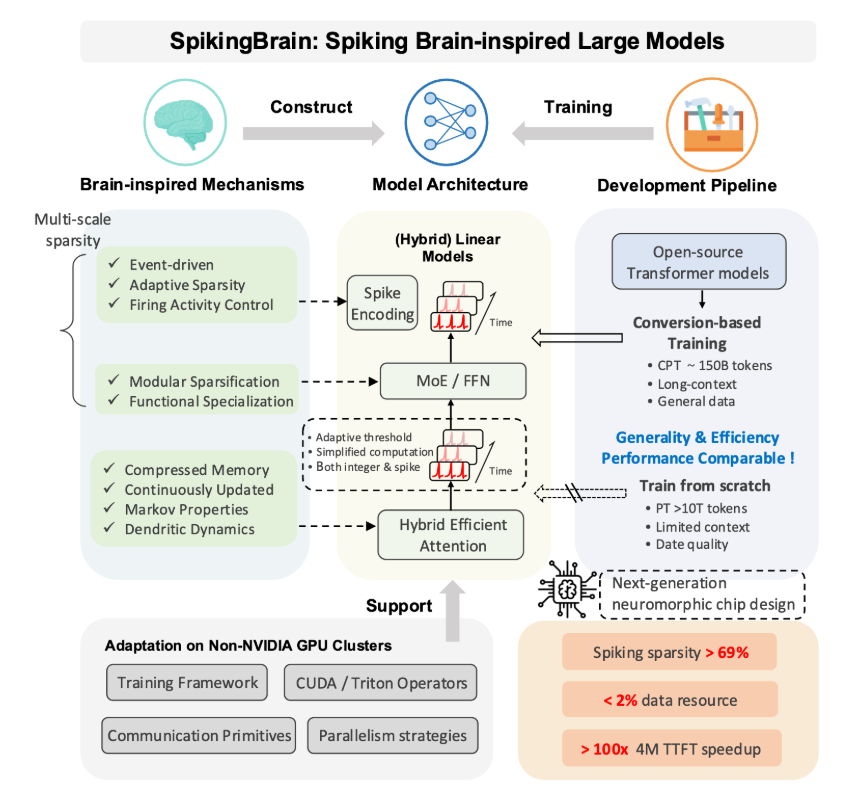

近日,中国科学院自动化研究所的李国齐与徐波团队联合发布了全球首款大规模类脑脉冲大模型 ——SpikingBrain1.0。该模型在处理长文本时展现出惊人的速度,能够以超过当前主流 Transformer 模型100多倍的速度处理400万 token 的超长文本,且仅需2% 的数据量。

当前主流的大语言模型,如 GPT 系列,普遍基于 Transformer 架构。尽管 Transformer 以其强大的自注意力机制而闻名,但其计算复杂度却是一个致命的短板。在文本长度增加时,计算量呈现出平方级别的暴涨,使得长文本的处理变得异常耗时和耗能。这一现象让 AI 在分析长篇小说或法律文书时显得力不从心。

为了寻求新的解决方案,研究团队将目光投向了自然界最为高效的智能系统 —— 人脑。人脑由千亿神经元构成,功耗却仅为20瓦。团队提出了 “基于内生复杂性” 的理念,旨在提升模型内部单元的效率与智能。

SpikingBrain 模型通过全新的架构模拟了人脑神经元的工作方式,分为两个版本:SpikingBrain-7B(70亿参数)和 SpikingBrain-76B(760亿参数)。首先,该模型抛弃了传统 Transformer 的二次方复杂度自注意力机制,采用了 “混合线性注意力架构”,将计算复杂度降至线性(O (n)),显著提高了处理长文本的效率。

其次,SpikingBrain 引入了 “自适应阈值脉冲神经元”,使神经元的激活与否取决于接收到的信号强度。通过动态调整阈值,模型确保神经元在高效能状态下工作,这种事件驱动的机制显著节省了能耗,计算稀疏度高达69.15%。

此外,团队还开发了一套高效的模型转换技术,能够将现有的 Transformer 模型直接转化为 SpikingBrain 架构,降低了训练成本。所有技术细节和代码已在 GitHub 及魔搭平台上开源,供全球研究人员使用。

此次 SpikingBrain 的问世,不仅在计算效率上取得了重大突破,也为未来的通用人工智能提供了一条新思路。